La ética no es un juego de imitación

Gonzalo Génova, Universidad Carlos III

The Imitation Game es el título de la película de 2014 que relata la vida de Alan Turing. La expresión “el juego de imitación” es del propio Turing: son las primeras palabras de su artículo de 1950, Máquinas computacionales e inteligencia, en el que propone su famoso experimento –el Test de Turing– para determinar si una máquina puede pensar.

Eran los inicios de la inteligencia artificial. Las cuestiones éticas que esta plantea tienen cada vez más importancia. En este artículo reflexiono, además, sobre lo que podemos aprender nosotros cuando nos planteamos cómo enseñar comportamiento ético a una máquina.

La ética programada

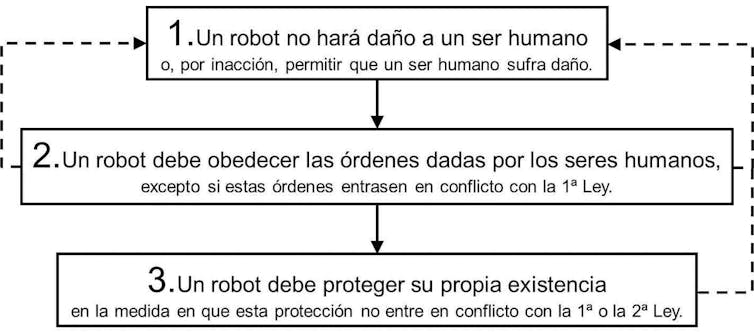

El comportamiento ético de las máquinas siempre ha sido un tema dado a la especulación más o menos fantasiosa, muy especialmente a la ciencia ficción. Un ejemplo paradigmático es Isaac Asimov y sus famosísimas tres leyes de la robótica, formuladas por primera vez en un relato escrito en 1941 (Círculo vicioso).

Las tres leyes de la robótica son un intento de programar explícitamente un código ético en un robot, lo que podríamos llamar una ética programada.

La programación clásica, explícita, es una descripción procedimental de las instrucciones que tiene que seguir una máquina computacional (un ordenador) para llevar a cabo una tarea. Puede ser sumar dos números, llevar un paquete de un lugar a otro, realizar un trasplante de córnea…

Este tipo de programación trata de descomponer el problema en instrucciones secuenciales, repeticiones y caminos alternativos (estos últimos en función de que se cumplan o no determinadas condiciones).

La ética aprendida

La verdad es que entender la ética de esa manera, encorsetada dentro de un código que sea capaz de contemplar todos los casos posibles cuando se enfrente a ellos (que es lo que hace un programa) resulta bastante problemático.

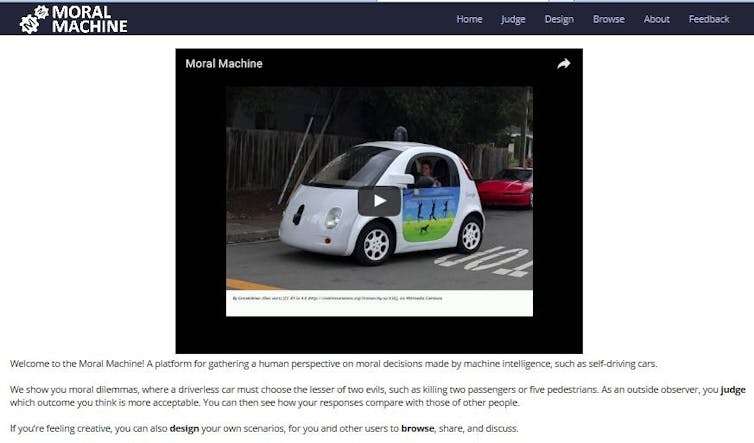

En los últimos años ha surgido otro enfoque que podemos llamar ética aprendida, implícita, de la mano de los desarrollos en inteligencia artificial. En el MIT (el Massachusetts Institute of Technology) han desarrollado un experimento “para tratar de hacer que las máquinas sean más morales”, al que han bautizado como la Moral Machine:

¡Bienvenidos a la Máquina Moral! Una plataforma para recopilar una perspectiva humana sobre las decisiones morales tomadas por las máquinas inteligentes, como los coches autónomos…

Enseñar a las máquinas a tomar decisiones

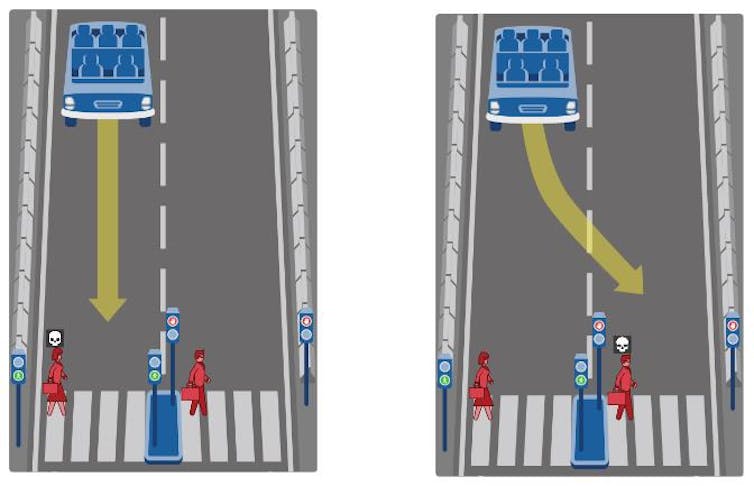

El dominio de los vehículos autónomos está muy presente en los medios de comunicación. Para abordar los dilemas de la conducción a los que se enfrentan, los expertos intentan aprender de las respuestas que la gente común daría a estas cuestiones.

Como no sabemos cómo programar explícitamente el código ético de un vehículo autónomo, preguntemos a las personas: ¿y usted qué haría? En esta situación. Y en esta otra. Y así sucesivamente. A partir del conjunto de respuestas se extrae información, hasta llegar a construir un conjunto de patrones de comportamiento.

Algo semejante se hace en otros dominios: como no sabemos programar con reglas explícitas cómo reconocer un rostro humano, pedimos que la gente reconozca rostros y distinga si este está sonriendo, si este está enfadado, triste o preocupado. Se pueden reconocer así incluso gestos corporales: una muestra amistosa entre amigos que hace tiempo que no se ven o entre dos personas que cierran un trato, un gesto amenazador…

Todo esto son técnicas ya conocidas y que están funcionando: tratemos, pues, de aplicarlas para extraer conocimiento moral de las respuestas de la gente.

En la imagen vemos un ejemplo concreto: ¿a quién atropellaría el vehículo autónomo, a la mujer o al hombre? Y así con diversas situaciones, unas más complejas que otras, pero siempre en forma de dilema A o B: hombres o mujeres, ancianos o niños, gatos o perros, pasajeros o viandantes, etc.

Entre las figuritas que uno puede seleccionar, hay incluso un sanitario (hombre o mujer) que se identifica fácilmente por su maletín con una cruz blanca. Tal vez lleva la vacuna contra el coronavirus y salvándole a ella podríamos salvar a cientos de miles de personas. ¿Debe influir esto en nuestra decisión?

Problemas del aprendizaje automático

¿Qué problemas tiene esta forma de plantear las cuestiones éticas? En primer lugar, está el problema de la explicabilidad, que preocupa mucho a los investigadores.

En el aprendizaje automático (que es solo una rama de la inteligencia artificial) el resultado final es una fórmula, un algoritmo, para reconocer el rostro, el gesto, la escritura. Pero no se puede explicar por qué funciona. No hay otra justificación para la fórmula más allá de que tenga un porcentaje de éxito muy elevado, su efectividad. Y claro, cuando la decisión tiene una fuerte carga ética, el hecho de que no se pueda razonar es un problema serio, muy serio.

Otro problema que se plantea una y otra vez es el problema de los sesgos. Los algoritmos éticos tienen que evitar los sesgos, los que sean. Sesgos contra las mujeres, contra los afroamericanos, contra los que visten de forma poco convencional, etc.

¿Qué ocurre si la población a la que estamos encuestando en el experimento está sesgada? Estaremos reproduciendo el sesgo mayoritario, y eso no es admisible: si la mayoría está sesgada, no basta con imitarla, sino que hay que evitar el sesgo, por mucho que lo diga la mayoría.

Esto pone de relieve una cuestión muy interesante: sabemos que el sesgo, o el estar sesgado, es algo malo, independientemente de lo que diga la mayoría. O sea, el bien y el mal no es lo que dice la mayoría, sino que está más allá. Esta no es una reflexión original: está en los orígenes mismos de la reflexión ética en la filosofía griega. Lo interesante es que la inteligencia artificial lo vuelve a poner de relieve.

Pero, si no es lo que dice la mayoría, ¿cómo sabemos lo que está bien y lo que está mal? Un problema bien difícil… No voy a pretender que tengo la respuesta, lista para ser explicada en tres líneas. No obstante, sí me atrevo a decir que renunciar a intentar conocer el bien y el mal en sí mismos –y este “en sí mismos” quiere decir que están más allá de las mayorías– es una grave limitación de la investigación, de la educación, de las políticas sociales, públicas, etc.

Otro problema que se presenta, estrechamente relacionado con el anterior, es el problema de la selección de la muestra. La selección de personas a las que preguntamos: ¿a quién atropellaría? Pues bien, ¿a quién estamos preguntando, a gente normal y corriente o a sádicos? ¿Y por qué los sádicos no deberían entrar en la encuesta? ¿No estaremos sesgando la muestra? ¿Y cómo sabemos quiénes son gente normal y corriente, y quiénes son sádicos?

El criterio ético lo aplicamos ya en la selección de la muestra: es a priori, es anterior al experimento. Aunque no lo sepamos perfectamente, en cierto modo ya sabemos qué es lo bueno y qué es lo malo antes de hacer el experimento.

Ética, mayorías y pensamiento crítico

En definitiva, la ética no consiste en la imitación del comportamiento típico o mayoritario. Nosotros no enseñamos ética así, ni queremos que se enseñe así. Si un gobierno nacional o regional incluyera en sus programas educativos un planteamiento ético como el siguiente: “los niños y niñas tenéis que imitar a la mayoría”, ¿no nos rebelaríamos con tremenda indignación?

El germen mismo de la ética es el pensamiento crítico, el no conformarse con el pensamiento dominante, el compromiso de la propia conciencia con reconocer por sí misma lo que está bien y lo que está mal.

La ética no es un juego de imitación. La ética no consiste en seguir un código de conducta como el de las tres leyes de Asimov; pero tampoco consiste en imitar el comportamiento de otros. El aprendizaje por imitación es algo muy humano, pero si hay alguna diferencia entre #QuédateEnCasa y #HazAcopioDePapelHigiénico, esa diferencia no está en la cantidad de gente que se comporta de una manera u otra, sino en la razonabilidad de su comportamiento. La ética no se contagia como un virus, se aprende y se discurre racionalmente.

Este artículo es una versión resumida de uno aparecido anteriormente en Naukas y en el blog del autor, De máquinas e intenciones.![]()

Gonzalo Génova, Profesor Titular de Lenguajes y Sistemas Informáticos, Universidad Carlos III

Este artículo fue publicado originalmente en The Conversation. Lea el original.